GPT-4: l’intelligence artificielle gagne en intelligence «humaine»

Après le fameux ChatGPT, l’Américain OpenAI vient de lancer GPT-4, une nouvelle version encore plus performante. Désormais doté de la reconnaissance des textes et des images, il constitue un pas de plus vers des programmes informatiques aussi «intelligents» que les humains.

L’entreprise californienne OpenAI, à l’origine du phénomène ChatGPT, a lancé hier mardi GPT-4, une nouvelle version de la technologie d’intelligence artificielle générative qui opère le célèbre chatbot, et qui constitue d’après ses concepteurs un pas supplémentaire vers des programmes informatiques aussi « intelligents » que les humains.

Microsoft, qui a investi dans la start-up, a annoncé dans la foulée avoir intégré GPT-4 à Bing, son moteur de recherche déjà doté de fonctionnalités de ChatGPT depuis un mois. «GPT-4 est moins doué que les humains dans de nombreux scénarios de la vie réelle, mais aussi performant que les humains dans de nombreux contextes professionnels et académiques», a indiqué OpenAI dans un communiqué.

Avec GPT-4, le chatbot va devenir «plus créatif et collaboratif que jamais», promet l’entreprise. Contrairement aux versions précédentes, le nouveau modèle est équipé de la vision: il comprend le texte mais aussi les images, grâce à une autre start-up, Be My Eyes. Il ne génère en revanche que du texte. Dans l’immédiat, seuls les utilisateurs de ChatGPT Plus, la version payante du chatbot, et le million d’internautes ayant accès au nouveau Bing vont pouvoir tester GPT-4 (sans le traitement d’images pour l’instant).

«Plus intelligents que les humains»

Les capacités multimédia de GPT-4 constituent un pas dans la direction de l’intelligence artificielle dite «générale». Le concept désigne des systèmes d’IA dotés de capacités cognitives humaines, ou «plus intelligents que les humains en général», selon le patron de la start-up, Sam Altman.

Pour l’instant, le modèle manque d’une capacité cruciale: la mémoire. Il a été formé sur des données qui s’arrêtent en septembre 2021 et «n’apprend pas en continu de ses expériences», détaille OpenAI. Il a en revanche gagné du terrain académique: «il réussit l’examen pour devenir avocat avec un score aussi bon que les meilleurs 10%. La version précédente, GPT 3.5, était au niveau des 10% les moins bons», s’est félicitée l’entreprise.

«GPT-4 peut désormais postuler pour étudier à Stanford (une prestigieuse université américaine, ndlr). Sa capacité à raisonner c’est du JAMAIS-VU! », a tweeté Jim Fan, un spécialiste de l’IA passé par Google et OpenAI, et désormais chez Nvidia. Il a admis avoir reçu de moins bons résultats à certains examens que le modèle.

« La puissance de l’algorithme va augmenter, mais ce n’est pas une deuxième révolution. On n’est pas passé de la Lune à Mars», a nuancé Robert Vesoul, PDG de l’entreprise française Illuin Technology. «Malgré ses capacités, GPT-4 a des limites similaires aux modèles précédents», a reconnu OpenAI. «Il n’est pas encore totalement fiable.»

La course à l’IA est lancée

L’engouement pour ChatGPT a lancé une course à l’IA générative. En tête, Microsoft et Google ont intégré des outils de création automatisée sur leurs plateformes et logiciels en ligne, pour faciliter la production d’emails, de campagnes publicitaires et d’autres documents… non sans couacs et erreurs.

Morgan Stanley a annoncé mardi qu’elle allait utiliser GPT-4, qui permet «d’avoir toutes les connaissances de la personne la plus qualifiée en gestion de fortune - instantanément». Le géant des tutoriels Khan Academy et l’application de paiement Stripe vont aussi intégrer des fonctionnalités de GPT-4.

Cette progression rapide de l’IA générative inquiète de nombreuses professions intellectuelles et créatives, qui s’imaginent déjà réduites au rôle de gestion des chatbots pour en tirer les meilleurs textes et images. Ces technologies ont aussi le potentiel d’être utilisées à des fins néfastes.

L’entreprise a annoncé avoir engagé plus de 50 experts pour évaluer les nouveaux dangers qui pourraient émerger, pour la cybersécurité par exemple, en plus des risques déjà connus (génération de conseils dangereux, code informatique défectueux, fausses informations, etc.).

Leurs retours et analyses doivent permettre d’améliorer le modèle. « Nous avons notamment récolté des données supplémentaires pour nous assurer que GPT-4 refuse les requêtes d’utilisateurs sur la fabrication de produits chimiques dangereux », a déclaré OpenAI.

Le 15 Mars 2023

Source web par : le360

Les tags en relation

Les articles en relation

Intelligence artificielle et transport aérien, état des lieux et perspectives

S’il est difficile, de l’avis même des experts, de définir ce que c’est que l’intelligence artificielle (IA), il n’en demeure pas moins vrai qu’on...

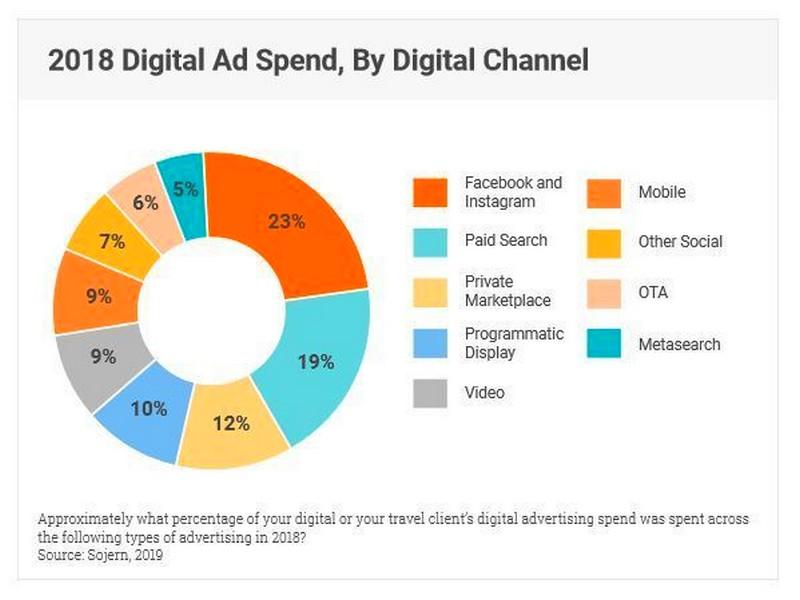

Comment les acteurs du Tourisme font-ils de la publicité en ligne?

Dans une étude intitulée « State of the Industry : The 2019 Report on Travel Advertising », Sojern s’intéresse aux acteurs du Tourisme et à leurs campag...

3 étapes clés pour créer son programme de commandite

Connaître ses participants, définir ses atouts et savoir les présenter efficacement à des partenaires potentiels sont des phases essentielles à la mise sur...

Pourquoi OpenAI a dû désactiver ChatGPT en urgence ?

Au début de cette semaine, les internautes ont été surpris par une panne de l’agent conversationnel ChatGPT. En réalité, c'est OpenAI qui a été con...

Microsoft admet écouter les conversations de ses utilisateurs

TECHNOLOGIE - De si grandes oreilles. Le géant américain de l’informatique Microsoft a confirmé ce mercredi 7 août que certaines conversations d’utilisa...

Intelligence artificielle : des experts appellent à la création d’instances de régulation indé

Les résultats de la course effrénée que se livrent les géants de la tech concernant l’Intelligence artificielle commencent à inquiéter. L’ONG américa...

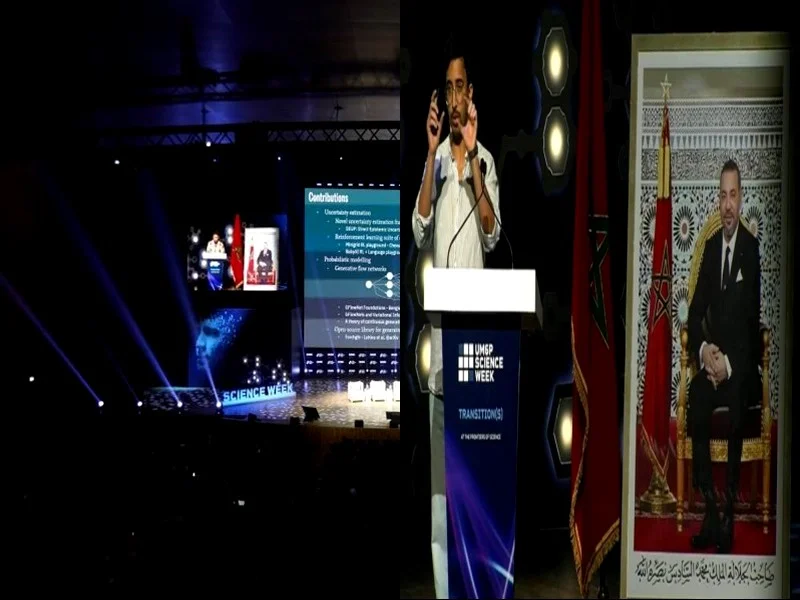

L'Intelligence Artificielle à l'honneur lors de la Semaine de la Science de l'UM6P : Focus sur 8 Je

Évoquer les transitions sans aborder le domaine de l'Intelligence Artificielle (IA) avec ses diverses applications et ses promesses multiples serait incomp...

Voiture autonome : Google tente une première mondiale

Waymo, la filiale d'Alphabet (Google), vient d'annoncer le lancement d'un service de taxi assuré par ses voitures autonomes. Ces dernières circule...

Visualiser la Digitalisation à l'Échelle Mondiale à travers 10 Graphiques

Des télécommunications aux services financiers, en passant par la santé et l'éducation, les technologies numériques sont à l'origine d'une tra...

Intelligence artificielle : quand MBUX Hey Mercedes rencontre ChatGPT

Le phénomène ChatGPT fascine. Pas un jour ne passe sans qu’on n’entende parler des prouesses de la star des intelligences artificielles et de l’infinit�...

Mark Zuckerberg dévoile une technologie révolutionnaire aux airs de science-fiction

Mark Zuckerberg dévoile les avancées de Meta dans la recherche de nouvelles technologies révolutionnaires. L'entrepreneur américain a récemment annonc�...

Comment l’Intelligence artificielle révolutionne la conception actuelle des organisations (Confé

Le mouvement lié à l’intelligence artificielle n’en est qu’à son début. Et il faudra du temps pour se l’approprier complètement. Pourtant, plusieur...

vendredi 31 mars 2023

vendredi 31 mars 2023 0

0

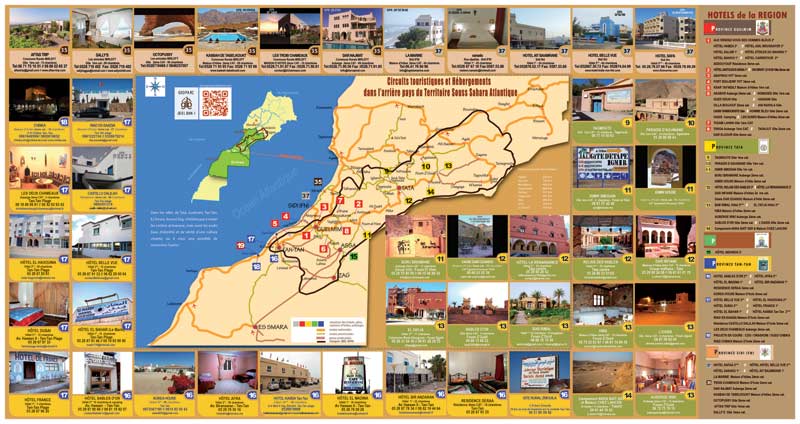

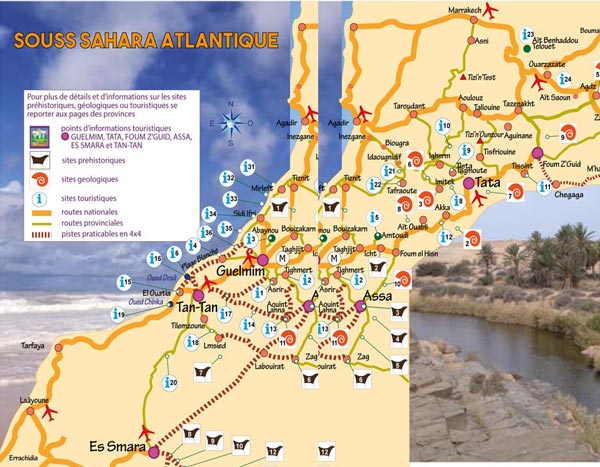

Découvrir notre région

Découvrir notre région